Las claves que explican la baja de la inflación y qué esperan para los próximos meses

Las claves que explican la baja de la inflación y qué esperan para los próximos meses

EN FOTOS | El Museo de La Plata ya luce renovado y la joya del Bosque platense vuelve a brillar

Crisis en IOMA: la oposición pide la interpelación de su presidente

ATENCIÓN | Cambió el pronóstico del tiempo para La Plata: anuncian lluvias para el fin de semana

Falsa cita en La Plata: una trampa sexual que acabó en extorsión

El efectivo vuelve a ser atractivo en La Plata: descuentos de hasta el 40% en comercios

El Concurso de EL DIA y su primer ganador: ya se juega por otro álbum y 20 paquetes de figuritas

VIDEO. Tremendo blooper de una periodista en TN que derivó en un corte

Este finde se sale en La Plata: la agenda de espectáculos con shows, teatro, música y más

Casa Metro presenta “La Luna Cautiva” y un show inmersivo con canciones de Fito Páez

Diputado libertario y otro escándalo: desde Milagro Sala al Tesla de US$ 250 mil

Quedó expuesto: un docente platense “chapeaba” con ser novio de Lali Espósito

Romance confirmado: se filtró la primera foto de Mauricio Macri con su nueva novia

Personal y empresas para reparación de viviendas y service del hogar

Uno por uno, los cortes de luz programados para este viernes en La Plata: las zonas afectadas

Una pelea por supuestas estafas frente a una maderera terminó con seis demorados en La Plata

Prisión preventiva para el acusado de abusar y golpear a su expareja en Pilar

Cuenta DNI: los descuentos que hay para hoy viernes 15 de mayo 2026

Actividades: talleres en Villa Elisa, clases de plástica, festejo de jubilados

Los números de la suerte del viernes 15 de mayo de 2026, según el signo del zodíaco

Estimado lector, muchas gracias por su interés en nuestras notas. Hemos incorporado el registro con el objetivo de mejorar la información que le brindamos de acuerdo a sus intereses. Para más información haga clic aquí

En una época donde la realidad puede ser replicada, distorsionada y vendida como verdad, la diferencia entre la información y la manipulación parece cada vez más difusa

Por más perfecta que parezca, la mentira siempre deja una huella. Y en tiempos donde los rostros se imitan, las voces se clonan y los gestos se falsean con una precisión escalofriante gracias a la inteligencia artificial, el ojo humano todavía resiste. El fenómeno de los deepfakes —esas imágenes, audios y videos generados por algoritmos que recrean casi a la perfección a una persona haciendo o diciendo algo que nunca hizo ni dijo— se expandió como un virus invisible por las redes, con consecuencias que van desde bromas pesadas hasta operaciones de desinformación política y fraudes económicos.

En un mundo donde un video de Lionel Messi promocionando una estafa piramidal o un audio de Mirtha Legrand pidiendo rescate por un secuestro ficticio podrían volverse virales en minutos, los deepfakes —creaciones hiperrealistas generadas por inteligencia artificial— ya no son ciencia ficción. Su uso crece a un ritmo alarmante: según proyecciones internacionales, el mercado de esta tecnología pasará de mover 564 millones de dólares en 2024 a más de 5.000 millones en 2030, con un crecimiento anual del 44%. Pero, ¿cómo distinguir lo real de lo falso en un país donde el 30% de la población aún desconoce qué son los deepfakes?

Argentina no está exenta de esta ola. Según datos recientes, el uso de deepfakes en nuestro país se disparó un 770% entre 2022 y 2023. En paralelo, Brasil lo hizo en un 830% y México en un 700%, evidenciando una tendencia regional alimentada por el acceso masivo a aplicaciones de intercambio de rostros, videos generativos y programas de síntesis vocal. Herramientas que hasta hace poco estaban reservadas a laboratorios informáticos de alto vuelo hoy se descargan gratis desde cualquier celular. Y mientras la tecnología mejora su capacidad para imitar, la sociedad parece no mejorar al mismo ritmo su capacidad para distinguir.

En Argentina, aunque su adopción es incipiente comparada con Europa o Asia, ya hay casos emblemáticos. Startups locales utilizan IA para crear avatares digitales de figuras históricas en museos interactivos, mientras que en el marketing, empresas apuestan por influencers virtuales para reducir costos. Sin embargo, el lado oscuro avanza más rápido: América Latina y el Caribe registraron un aumento del 255% en deepfakes maliciosos durante 2023, según datos de iProov.

“En los últimos seis meses, atendimos tres casos de extorsión a pymes usando audios falsos de supuestos directivos”, revelan algunos expertos en ciberseguridad. Los delincuentes piden transferencias urgentes con voces clonadas en segundos usando herramientas como DeepVoice o Resemble AI, accesibles hasta en la Dark Web.

Hay personas que utilizan herramientas para modificar su apariencia / Didit

Existen ciertas herramientas que permiten detectar deepfakes / Web

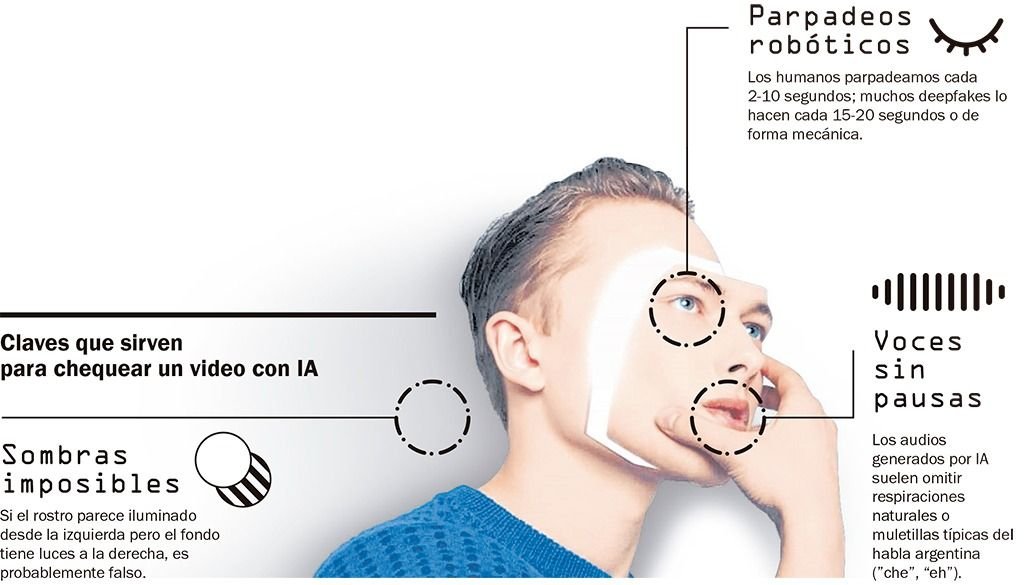

Sin embargo, los deepfakes aún no son infalibles. Aunque la inteligencia artificial haya aprendido a simular la textura de la piel, la luz en los ojos o los temblores sutiles de una voz nerviosa, hay errores que delatan la trampa. Pequeñas incoherencias que, con algo de atención, pueden marcar la diferencia entre una verdad reproducida y una falsificación peligrosa.

Una de las señales más frecuentes está en la mirada. Los humanos tenemos patrones naturales de parpadeo y movimiento ocular que la mayoría de los deepfakes todavía no logra replicar con fluidez. El ojo humano percibe cuando un parpadeo tarda demasiado o cuando la mirada parece estática o desconectada del contexto emocional de la escena. Otro punto débil son las manos: dedos mal renderizados, movimientos antinaturales o simplemente formas imposibles en una toma, suelen ser el talón de Aquiles de las imágenes generadas por IA. Algo similar ocurre con las sombras y los reflejos, que a menudo no coinciden con la dirección de la luz ambiente o revelan inconsistencias en objetos espejados como los anteojos o los ojos.

En el caso de los videos, otro error recurrente es la desincronización entre los labios y el audio. Si bien la tecnología de “lip-sync” avanza a pasos agigantados, aún cuesta lograr una coincidencia perfecta cuando el personaje dice palabras complejas, ríe o gesticula con intensidad. Lo mismo vale para los tonos de piel: en algunos deepfakes el rostro tiene un color o una textura distinta al cuello o las manos, lo cual genera un efecto incómodo que el cerebro humano capta incluso sin necesidad de razonar.

Aunque la tecnología mejora, los deepfakes aún dejan huellas digitales. Investigadores explican que las redes neuronales tienen dificultades para replicar la física de la luz en los ojos humanos. “En imágenes reales, los reflejos en ambas retinas son simétricos. En un deepfake, suelen verse como manchas incoherentes, algo que hasta un usuario común puede notar con atención”, detallan otros especialistas en visión computacional.

Mientras gigantes como Meta y Google invierten millones en detectores automáticos, en Argentina la defensa sigue siendo artesanal. BioID, una herramienta europea usada por bancos locales, analiza microgestos como el ritmo del pulso en la piel (imperceptible para humanos) para verificar identidades. Pero los especialistas insisten en que la educación es clave:

La regla de los 3 segundos: antes de compartir un video polémico de un político o famoso, detenerse a observar reflejos en los ojos y sincronía de labios.

Chequear la fuente: ¿el video fue subido por un medio serio o un perfil anónimo? ¿Hay versiones oficiales desmintiéndolo?

Usar la tecnología a favor: extensiones como InVID permiten analizar frames de videos para encontrar ediciones.

ESTA NOTA ES EXCLUSIVA PARA SUSCRIPTORES

HA ALCANZADO EL LIMITE DE NOTAS GRATUITAS

Para disfrutar este artículo, análisis y más,

por favor, suscríbase a uno de nuestros planes digitales

¿Ya tiene suscripción? Ingresar

Full Promocional mensual

$740/mes

*LOS PRIMEROS 3 MESES, LUEGO $6990

Acceso ilimitado a www.eldia.com

Acceso a la versión PDF

Beneficios Club El Día

Básico Promocional mensual

$570/mes

*LOS PRIMEROS 3 MESES, LUEGO $4500

Acceso ilimitado a www.eldia.com

Diario El Día de La Plata, fundado el 2 de Marzo de 1884.

© 2026 El Día SA - Todos los derechos reservados.

Registro DNDA Nº RL-2024-69526764-APN-DNDA#MJ Propietario El Día SAICYF. Edición Nro. 6986 Director: Raúl Kraiselburd. Diag. 80 Nro. 815 - La Plata - Pcia. de Bs. As.

Bienvenido

Estimado lector, muchas gracias por su interés en nuestras notas. Hemos incorporado el registro con el objetivo de mejorar la información que le brindamos de acuerdo a sus intereses. Para más información haga clic aquí

Ante cualquier inconveniente durante el inicio de sesión, por favor escribanos a sistemas@eldia.com

Bienvenido

Estimado lector, con sólo registrarse tendrá acceso a 80 artículos por mes en forma gratuita. Para más información haga clic aquí

DATOS PERSONALES

Ante cualquier inconveniente durante el inicio de sesión, por favor escribanos a sistemas@eldia.com

¿Querés recibir notificaciones de alertas?

Para comentar suscribite haciendo click aquí